Artículo de Investigación

ESPAÑA FRENTE A LA DESINFORMACIÓN: DESAFÍOS HÍBRIDOS Y RESPUESTAS CONVENCIONALES

Juan Francisco Adame Hernández

Director de Estrategia, Comunicación y Promoción de Casa Árabe

Máster Universitario en Alta Dirección en Seguridad Internacional

Máster en Estudios Avanzados en Comunicación Política

Recibido 08/04/2025

Aceptado 03/06/2025

Publicado 27/06/2025

Cita recomendada: Adame, J. F. (2025). España frente a la desinformación: desafíos híbridos y respuestas convencionales. Revista Logos Guardia Civil, 3(2), pp. 37-70.

Licencia: Este artículo se publica bajo la licencia Creative Commons Atribución-NoComercial-SinDerivadas 4.0 Internacional (CC BY-NC-ND 4.0)

Depósito Legal: M-3619-2023

NIPO en línea: 126-23-019-8

ISSN en línea: 2952-394X

ESPAÑA FRENTE A LA DESINFORMACIÓN:

DESAFÍOS HÍBRIDOS Y RESPUESTAS CONVENCIONALES

Sumario: 1. INTRODUCCIÓN. 2. DESINFORMACIÓN, POSVERDAD Y FAKE NEWS. 2.1. Conceptos y definiciones. 3. ESTRATEGIAS HÍBRIDAS Y ZONA GRIS. 3.1. Manipulación e interferencia de información extranjera (FIMI). 4. DOMINIO COGNITIVO Y DESINFORMACIÓN. 5. CONSTRUCCIÓN DE NARRATIVAS Y MARCOS. 5.1. Implementación. 5.2. Impacto de las Narrativas y los Marcos en el Dominio Cognitivo. 6. EVOLUCIÓN DE LA DESINFORMACIÓN. 7. MEDIDAS Y HERRAMIENTAS ACTUALES PARA COMBATIR LA DESINFORMACIÓN EN ESPAÑA. 7.1. Procedimiento de Actuación contra la Desinformación. 8 CONCLUSIONES. 9 REFERENCIAS BIBLIOGRÁFICAS.

Resumen: En el actual entorno geopolítico, caracterizado por la proliferación de tecnologías de la información y la interconexión global, la desinformación se ha consolidado como una amenaza multidimensional que compromete las estructuras de seguridad nacional y la cohesión social de los Estados. Este artículo analiza la respuesta institucional y estratégica de España frente a la desinformación, enmarcándola dentro del contexto más amplio de las estrategias híbridas y de la interferencia y manipulación informativa extranjera (FIMI).

El estudio aborda conceptos clave como desinformación, posverdad y zona gris, vinculándolos con la evolución doctrinal de las estrategias híbridas en el seno de la Unión Europea. Se presta especial atención al dominio cognitivo y a los mecanismos de construcción de narrativas y marcos interpretativos empleados para moldear y distorsionar la percepción pública. La última sección ofrece una evaluación crítica de las principales medidas adoptadas por España para contrarrestar la desinformación, valorando su coherencia, aplicación y eficacia en un panorama de amenazas en constante transformación.

Abstract: In today’s geopolitical environment—marked by the proliferation of information technologies and global interconnectedness—disinformation has emerged as a multidimensional threat to national security structures and the social cohesion of states. This article analyzes Spain’s institutional and strategic response to disinformation, situating it within the broader framework of hybrid strategies and foreign information manipulation and interference (FIMI).

The study first clarifies key concepts such as disinformation, post-truth, and the grey zone, linking them to the doctrinal evolution of hybrid threats in the European Union. Particular attention is paid to the cognitive domain and the ways in which narrative construction and framing mechanisms are used to shape and distort public perception. The final section provides a critical assessment of the main counter-disinformation measures adopted by Spain, evaluating their coherence, implementation, and overall effectiveness in the face of a rapidly evolving threat landscape.

Palabras clave: Desinformación, Fake news, Estrategias híbridas, Dominio cognitivo, Narrativas.

Keywords: Disinformation, Fake news, Hybrid strategies, Cognitive domain, Narratives.

ABREVIATURAS

CIS: Centro de Investigaciones Sociológicas

CNI: Centro Nacional de Inteligencia

DESI: Digital Economy and Society Index

DSN: Departamento de Seguridad Nacional

EEAS/SEAE: European External Action Service/Servicio Europeo de Acción Exterior

ELISA: Estudio Simplificado de Fuentes Abiertas

ENISA: Unión Europea para la Ciberseguridad

ESN: Estrategia de Seguridad Nacional

EU/UE: Unión Europea

FIMI: Foreign Information Manipulation and Interference (Manipulación e Interferencia de Información Extranjera)

FIP: Federación Internacional de Periodistas

INCIBE: Instituto Nacional de Ciberseguridad es ciberseguridad

MAEUEC: Ministerio de Asuntos Exteriores, Unión Europea y Cooperación

MPJRC: Ministerio de la Presidencia, Justicia y Relaciones de las Cortes

OMS: Organización Mundial de la Salud

OTAN/NATO: Organización del Tratado del Atlántico Norte/North Atlantic Treaty Organization

1. INTRODUCCIÓN

En la era digital actual, marcada por la rápida difusión de información a través de las redes sociales y las tecnologías de la comunicación, la desinformación se ha convertido en una amenaza estratégica de primer orden. Este fenómeno, que incluye las noticias falsas (fake news) y la posverdad, ha adquirido una relevancia sin precedentes en el ámbito geopolítico, afectando tanto la estabilidad de los sistemas políticos como la percepción pública y la seguridad nacional. España no ha sido ajena a estos desafíos, enfrentándose a campañas de desinformación que, en muchos casos, han sido utilizadas como herramientas dentro de estrategias híbridas más amplias.

A menudo se interpreta la desinformación como un fenómeno en sí mismo o se aborda de una manera aislada o descontextualizada (Lazer et al., 2018). Se relativiza, se abstrae o se obvian las estrategias en las que la desinformación está inserta (MAEUEC, 2021). Obviando el necesario enfoque multidisciplinar (Wardle y Derakhshan, 2017) o la necesidad de identificar los objetivos estratégicos que estas acciones o campañas de desinformación persiguen (Terán, 2019). Incluso cuando hay una referencia a las estrategias híbridas y/o a la zona gris, habitualmente no suele abordarse en profundidad, quedando relegado a la mera mención (DSN, 2021). La desinformación, lejos de ser un fenómeno aislado, se inserta dentro de un marco estratégico más amplio, incluyendo las estrategias híbridas y la llamada "zona gris" (OTAN, 2024) y especialmente en la Manipulación e interferencia de información extranjera (FIMI, Foreign Information Manipulation and Interference).

2. DESINFORMACIÓN, POSVERDAD Y FAKE NEWS

La desinformación, no es un fenómeno reciente (Allcott y Gentzkow, 2017; Tandoc, Lim & Ling, 2018). Desde que las sociedades comenzaron a organizarse en estructuras jerárquicas, los seres humanos han fabricado y difundido deliberadamente historias incorrectas y engañosas (Burkhardt, 2017). Desde las tácticas de difamación política en la Antigua Roma hasta las estrategias de propaganda durante la Primera y Segunda Guerra Mundial (Posetti y Matthews, 2018), la desinformación ha sido utilizada para manipular y convencer a otros. La desinformación ha alcanzado niveles sin precedentes, alterando no solo la percepción pública, sino también influyendo directamente en procesos políticos y sociales a nivel global. Sin embargo, como repasan Julie Posetti y Alice Matthews en su compilación "A Short Guide to History of Fake News and Disinformation" (2018), la fabricación y manipulación de la información no es un fenómeno nuevo.

En los últimos años los medios de comunicación, las campañas políticas o los debates deportivos (o extradeportivos) en redes sociales se han llenado de nuevos conceptos como noticias falsas o fake news (Tandoc, Lim & Ling, 2018), la posverdad (McIntyre, 2018) o la disinformation/misinformation (Comisión Europea, 2022). Ha ganado relevancia pública debido a una serie de sucesos internacionales, como lo sucedido con el mundial de Qatar (Newtral, 2022), el escándalo de Cambridge Analytica (Chan, 2020) o lo sucedido en las elecciones presidenciales de Estados Unidos (BBC Mundo, 2018); lo que ha reavivado el debate sobre sus implicaciones para los sistemas democráticos, la percepción pública y los intereses geopolíticos de ciertos países. Es un debate recurrente, donde suelen destacarse el papel de las redes sociales, los medios de comunicación tradicionales, los verificadores o la ciberseguridad. Esta realidad polisémica, confusa y a menudo ambigua agrupa diferentes conceptos que intentan nombrar, explicar o aludir diferentes realidades.

2.1. CONCEPTOS Y DEFINICIONES

La desinformación, las fake news o la posverdad son términos, palabras y conceptos que se han popularizado mucho, pasando a formar parte del habla coloquial y habitualmente usándose como sinónimos para intentar reflejar una realidad habitualmente diferente y compleja. Sin embargo, aunque estos términos se utilizan frecuentemente de manera intercambiable, cada uno tiene matices y características específicas que los distinguen, lo que es crucial para una comprensión más profunda del fenómeno (DSN, 2022).

Tabla 1

|

Concepto |

Definición |

Relación con la verdad |

|

Fake News |

Noticias inventadas sin base real |

Falsa completamente |

|

Posverdad |

Cuando importan más las emociones que los hechos |

Lo emocional prima sobre lo verdadero |

|

Desinformación |

Información falsa o manipulada difundida deliberadamente con fines estratégicos |

Mezcla verdades y falsedades para generar un efecto concreto |

Fuente: Elaboración propia

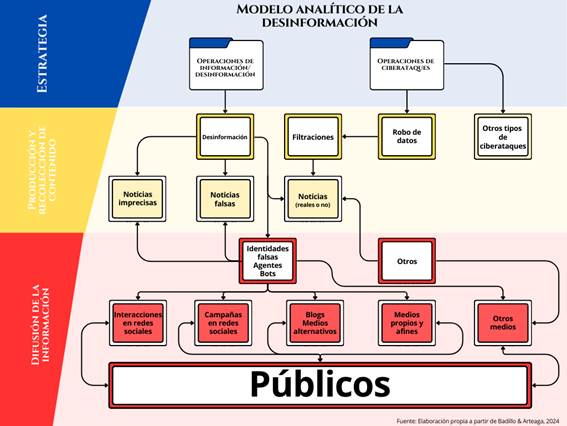

Empecemos desenmarañando esta compleja mescolanza temática por el aspecto más sencillo, las fake news o noticias falsas. Entendemos como fake news aquellas noticias falsas e inventadas[1] (Gelfert, 2018). Estas noticias no solo son fabricadas sin ninguna base en la realidad, sino que a menudo son diseñadas para parecer plausibles y manipular a la audiencia, explotando emociones y prejuicios para maximizar su impacto (DSN, 2022)[2]. Son supuestas noticias creadas desde la fantasía (dado que no tiene una relación con la realidad). Apoyándonos en la tabla 1, quizás es más fácil definirlas por oposición, no son ni noticias reales pero descontextualizadas ni noticias exageradas (de nuevo reales) ni noticas inexactas (con elementos reales) (DSN, 2023a). Es fundamental diferenciar las fake news de otros tipos de información incorrecta, como las noticias descontextualizadas o exageradas, ya que estas últimas, aunque potencialmente engañosas, están basadas en hechos reales, lo que las distingue de las noticias completamente fabricadas (DSN, 2022). Especialmente útil el modelo analítico de la desinformación propuesto por Badillo y Arteaga (2024) recogido en la Figura 1.

|

Figura 1

La posverdad[3] es un fenómeno multifacético (Caridad-Sebastián et al, 2018), donde es más relevante su verosimilitud (Rodrigo Alsina, 2005), que sea creíble, con independencia de los hechos ciertos o reales (Dahlgren, 2018). En la posverdad, las emociones y creencias personales prevalecen sobre los hechos objetivos, lo que tiene profundas implicaciones para la democracia y la cohesión social, ya que permite que narrativas emotivas y, a menudo, engañosas se impongan en el discurso público (DSN, 2022; DSN, 2024). Este fenómeno no solo altera la percepción individual, sino que también facilita la creación de "cámaras de eco"[4] en las que las personas son expuestas repetidamente a las mismas ideas, reforzando sus creencias y aislándolas de otras perspectivas (DSN, 2023a).

Sobre desinformación también hay múltiples definiciones, que han ido mutando con el paso del tiempo y en función del sector o ámbito donde se emplean o se esbozan (Arteaga, 2020). Este término abarca no solo la difusión intencional de información falsa, sino también la manipulación sutil de hechos para distorsionar la realidad y confundir al público (DSN, 2022). El DSN, alineándose con los postulados de la UE, la define como “Se considera desinformación a la información verificablemente falsa o engañosa que se crea, presenta y divulga con fines lucrativos o para inducir a error deliberadamente a la población, y que puede causar un perjuicio público” (DSN, 2022, p.253).

Aunque adecuada, esta definición restringe o minimiza algunos de los elementos que si se señalan en la Estrategia de Seguridad Nacional[5] como la referencia al ámbito cognitivo (DSN, 2021) o el énfasis en la intencionalidad y los objetivos de quienes llevan a cabo las campañas de desinformación (dotándolo así de un contexto). El impacto cognitivo de la desinformación es crucial, ya que no solo se trata de difundir información falsa, sino de alterar la percepción y el juicio del público, erosionando la confianza en las instituciones y fomentando la polarización social (DSN, 2022; DSN, 2023a). Opinión coincidente con otros autores como Artega u Olmo que señalan que “La desinformación permite fragmentar, aislar y manipular las opiniones públicas infectadas, desacreditar y cuestionar los hechos objetivos y acreditar como reales las emociones virtuales y las percepciones inducidas” (Artega, 2020) y “cuando la falsedad se vuelve más sutil, más compleja, ha sido creada con una intencionalidad táctica, responde a una estrategia y persigue objetivos, es cuando podemos hablar desinformación” (Olmo, 2019).

3. ESTRATEGIAS HÍBRIDAS Y ZONA GRIS

Las estrategias híbridas se definen como un enfoque de conflicto que combina elementos convencionales y no convencionales, utilizando una variedad de herramientas —militares, económicas, diplomáticas, cibernéticas y de información— para lograr objetivos estratégicos (Colom, 2018). Estas herramientas incluyen no solo la manipulación directa de la información, sino también la creación de narrativas que modifiquen la percepción pública en el largo plazo, una característica central tanto de las operaciones de influencia como de la desinformación (Torres Soriano, 2022). El uso de estas estrategias se justifica por su capacidad para explotar vulnerabilidades a través de un enfoque que integra lo militar con otros dominios, como el cognitivo y el informativo, creando una sinergia que multiplica su efectividad en contextos de baja intensidad (Walker, 1998).

La zona gris, por su parte, se caracteriza por la aplicación de tácticas diseñadas para permanecer por debajo del umbral que desencadenaría una guerra abierta. Este concepto es fundamental para comprender cómo los actores estatales y no estatales desafían el orden internacional sin cruzar las líneas rojas que llevarían a un conflicto armado (Martín Renedo, 2022). En la práctica, las operaciones en la zona gris incluyen desde la coerción económica y el uso de desinformación hasta el empleo de fuerzas especiales en misiones encubiertas, las cuales están diseñadas para ser difíciles de atribuir directamente a un Estado (McCuen, 2008). El solapamiento entre el plano físico, virtual y cognitivo en la zona gris permite la ejecución de estas estrategias de manera más efectiva, ya que la percepción del conflicto es manipulada para desorientar a las poblaciones objetivo y debilitar su capacidad de respuesta (Lupiáñez Lupiáñez, 2023).

Las estrategias híbridas[6] y la "zona gris" es una evolución de tácticas y estrategias históricas de guerra irregular, ahora potenciadas por la tecnología moderna y las redes de información, lo que permite una influencia más efectiva y menos detectable en un contexto global (Hafen, 2024). La desinformación, la propaganda y las operaciones de influencia son componentes esenciales de estas estrategias, que se despliegan en un entorno cada vez más complejo y globalizado (Hoffman, 2009).

La propaganda moderna va más allá de la simple difusión de mensajes; se trata de una manipulación sofisticada de la información para moldear percepciones y comportamientos en línea con los intereses estratégicos de quienes la promueven (Calvo Albero, 2017). La propaganda[7] puede ser vista como una extensión de las operaciones psicológicas, donde no solo se busca influir en la opinión pública, sino también desmoralizar al adversario y alterar su capacidad de decisión (Rid, 2021)[8]. Desde 2023, este tipo de operaciones se ha visto intensificado, especialmente en el contexto de conflictos globales como los ocurridos en Ucrania y Gaza, donde la propaganda ha jugado un papel crucial en la polarización de las opiniones públicas y la manipulación de la información a escala internacional (DSN, 2024)

En este contexto, la desinformación no solo actúa como una herramienta de influencia, sino que también facilita otras operaciones híbridas al debilitar la cohesión social y la confianza en las instituciones, creando un entorno propicio para la implementación de tácticas más agresivas sin necesidad de un enfrentamiento militar abierto (Alastuey Rivas et al, 2024). Es crucial comprender que las estrategias híbridas no son un fenómeno nuevo, sino una evolución de las tácticas de guerra irregular que han sido empleadas a lo largo de la historia, aunque los cambios sociales y el avance de la tecnología han ampliado enormemente las herramientas disponibles para estas estrategias, permitiendo su aplicación en una escala global y con un impacto significativo en la estabilidad internacional (Calvo, 2023). Esto se puede observar con nitidez en la Doctrina Primakov/Gerasimov rusa, en la concepción las "Tres Guerras" de China o en la "Nueva Conceptualización de la Zona Gris" occidental (Adame Hernández, 2024).

3.1. MANIPULACIÓN E INTERFERENCIA DE INFORMACIÓN EXTRANJERA (FIMI)

El concepto de Manipulación e interferencia de información extranjera (FIMI, Foreign Information Manipulation and Interference) hace referencia a las actividades deliberadas llevadas a cabo por actores extranjeros con el objetivo de distorsionar la información, manipular la percepción pública e influir en procesos políticos y sociales en otros países. Según el informe conjunto de la Agencia de la Unión Europea para la Ciberseguridad (ENISA) y el Servicio Europeo de Acción Exterior (SEAE), FIMI abarca una variedad de acciones que incluyen la difusión de desinformación, propaganda y operaciones psicológicas que buscan sembrar discordia y desestabilizar sociedades democráticas (ENISA & SEAE, 2022). La FIMI también puede involucrar la manipulación de narrativas culturales e históricas para avivar conflictos internos y desestabilizar el orden social, explotando temas sensibles que resuenan con los prejuicios o miedos existentes en una sociedad (Buvarp, 2021). La sofisticación de estas operaciones radica en su capacidad para aprovechar grietas preexistentes dentro de las sociedades objetivo, exacerbando divisiones y provocando reacciones que socavan la cohesión social y política (Allenby y Garreau, 2017). Estas actividades pueden tener consecuencias profundas para la estabilidad de las instituciones democráticas, ya que se enfocan en explotar las vulnerabilidades sociales y políticas (ENISA & SEAE, 2022).

En el contexto de FIMI, es esencial reconocer que estas operaciones no siempre involucran la difusión de información completamente falsa. A menudo, se basan en distorsiones sutiles de hechos reales, el empleo de técnicas como la saturación de la información o la creación de burbujas informativas (Rid, 2021); lo que dificulta la detección y la respuesta. Estas estrategias, denominadas como "manipulación sutil de la verdad", es particularmente peligrosa ya que juega con la percepción pública y la credibilidad de las fuentes informativas (Castro Torres, 2021). Además, la manipulación de la información a través de canales no tradicionales, como las redes sociales y plataformas de mensajería instantánea, permite a los actores extranjeros maximizar el impacto de sus campañas al aprovechar las características virales y el alcance global de estas herramientas (EEAS, 2024).

FIMI se enmarca dentro de las estrategias híbridas. La propaganda y las acciones de influencia son herramientas clave dentro del marco de FIMI. La propaganda es empleada para promover narrativas que favorecen los intereses del actor extranjero, utilizando medios de comunicación controlados o afines para diseminar mensajes específicos. Estas narrativas son diseñadas cuidadosamente para parecer legítimas y a menudo se apoyan en fuentes parciales o sesgadas que otorgan credibilidad a los mensajes difundidos (Maggioni y Magri, 2015). Narrativas ideadas para generar desconfianza hacia las instituciones democráticas y polarizar a la sociedad (Bennett & Livingston, 2020). Además, las acciones de influencia se dirigen a moldear la opinión pública o influir en decisiones políticas, lo que puede incluir desde la manipulación de redes sociales hasta la financiación encubierta de actores políticos o mediáticos en el país objetivo (SEAE, 2023). Un ejemplo reciente de este proceder se ha observado en las elecciones presidenciales rumanas (Comisión Europea, 2024). El anonimato que brindan las plataformas digitales y la posibilidad de operar a través de intermediarios o proxies añade una capa de complejidad a la hora de rastrear e identificar a los verdaderos perpetradores de estas campañas, lo que dificulta la implementación de contramedidas efectivas (Castro Torres, 2021). El uso de estos métodos ha permitido a los actores extranjeros operar con una capa adicional de anonimato y denegabilidad, complicando los esfuerzos para identificar y contrarrestar estas actividades (DSN, 2024).

4. DOMINIO COGNITIVO Y DESINFORMACIÓN

Aunque la conceptualización del dominio cognitivo es relativamente moderna, las estrategias para operar sobre él como la propaganda (Calvo, 2023), las acciones de influencia (Jordán, 2018) y desestabilización (Quiñones de la Iglesia, 2021) no lo son. Estas tácticas han sido históricamente utilizadas en diversos contextos geopolíticos, evolucionando con el tiempo para adaptarse a las nuevas tecnologías de la información y las cambiantes dinámicas sociales. Por ejemplo, la propaganda, que alguna vez dependió exclusivamente de medios tradicionales como la prensa y la radio, ahora se dispersa a través de plataformas digitales y redes sociales, permitiendo una mayor penetración y rapidez en la difusión de mensajes. Estas herramientas han adquirido una sofisticación sin precedentes, aprovechando la velocidad y el alcance de Internet y las redes sociales para amplificar sus efectos, como se observa en las tácticas empleadas por grupos como Al Qaeda y el Estado Islámico, que han usado estas tecnologías para influir en la opinión pública global y legitimar sus acciones (Astorga González, 2020). La influencia de las plataformas digitales es tal que permiten a los actores malintencionados segmentar audiencias y personalizar mensajes, creando cámaras de eco que refuerzan creencias preexistentes y dificultan la diseminación de información contraria. Esto se potencia con el uso de algoritmos que favorecen la polarización al priorizar contenido sensacionalista y emocionalmente cargado, lo que, a su vez, facilita la manipulación del dominio cognitivo a gran escala (DSN, 2023b).

La teoría estructuralista de Louis Althusser sobre la construcción ideológica, donde los medios de comunicación juegan un rol central en la creación y mantenimiento de las ideologías que dominan la percepción pública, refuerza la comprensión de cómo las tácticas de desinformación se insertan en el dominio cognitivo[9] (Althusser, 1971). En consonancia con esto, la manipulación del dominio cognitivo implica la creación de realidades percibidas que, aunque no necesariamente reflejen la realidad objetiva, se convierten en la base sobre la cual se toman decisiones políticas y sociales (Lupiáñez Lupiáñez, 2023). Como apuntan diversos autores como Foucault, el lenguaje no solo describe el mundo, sino que actúa sobre él (Foucault, 1972), lo que refuerza la idea de que el dominio cognitivo puede ser manipulado a través de la construcción de narrativas que reconfiguran la realidad percibida.

En relación a la desinformación, la zona gris se enfocará principalmente en establecer el contexto, utilizando estrategias como la propaganda o la desinformación, con el objetivo de obtener gradualmente una ventaja estratégica sobre el oponente, lo que facilitaría mejorar la eficacia de futuras intervenciones (Hernández-García, 2022). Libicki refuerza esta idea al explicar cómo las operaciones cognitivas no siempre buscan resultados inmediatos, sino que pueden estar diseñadas para sembrar dudas y confusión, afectando a largo plazo la capacidad de un adversario para tomar decisiones efectivas (Libicki, 2021). Este enfoque subraya la importancia de la gradualidad en la estrategia de desinformación, donde los pequeños cambios en la percepción y la narrativa pueden culminar en una alteración significativa de la realidad percibida, haciendo que el oponente pierda la iniciativa y el control sobre la situación. Destacar en esta aproximación la concurrencia entre objetivos, visión estratégica y gradualidad.

La relación entre la manipulación cognitiva y los conflictos políticos también se puede analizar desde la perspectiva clausewitziana. Clausewitz argumenta que la guerra es un acto político racional donde se busca desmoralizar al adversario no solo a través del conflicto directo, sino también manipulando las pasiones de la población y la percepción de la realidad (Clausewitz, 1976). A través de la desinformación es posible erosionar la moral tanto de un ejército enemigo como, de manera aún más significativa, de su población, con el propósito de persuadir a sus decisores políticos para que detengan su actitud beligerante, propiciar una negociación u obtener beneficios en una ya prevista (Rodríguez Lorenzo et al, 2023).

Un factor fundamental a considerar y que no suele atenderse más que de manera colateral es la relación y afectación política. Este aspecto, aunque crucial, a menudo se subestima en los análisis sobre desinformación, donde se pone mayor énfasis en los aspectos técnicos o tácticos, dejando de lado las implicaciones más amplias para la gobernanza y la estabilidad política. En una lógica clausewitziana, “si la guerra es de naturaleza política, resulta evidente que el objetivo principal no son las fuerzas armadas enemigas, sino el liderazgo político” (Calvo Albero, 2017).

Es la intersección entre la desinformación utilizada en las estrategias híbridas y de zona gris; con los objetivos perseguidos (especialmente la afectación política) donde conectan con la sociedad, la agenda y opinión pública (Sartori, 2007). En este contexto, la manipulación de la información y la creación de narrativas alternativas no solo impactan a nivel estatal o militar, sino que también tienen profundas implicaciones en el tejido social y cultural. La construcción de estos relatos, que utilizan el cine y los medios[10] como herramientas de manipulación emocional, sigue siendo fundamental para comprender cómo las narrativas malintencionadas pueden dividir y confundir a la sociedad (Davis, 2005). La capacidad de estas estrategias para modificar la percepción pública no solo se debe a la sofisticación de las tácticas empleadas, sino también a la manera en que estas narrativas se alinean con las preocupaciones y miedos existentes en la sociedad, amplificándolos y redirigiéndolos contra objetivos específicos (Castro Torres, 2021).

La construcción de relatos malintencionados, que buscan dividir y confundir a la sociedad, se convierte en una herramienta poderosa para desestabilizar no solo a los gobiernos, sino también a las comunidades y a la cohesión social en su conjunto. La necesidad de crear un relato malintencionado que pueda ser explotado en beneficio propio (Rodríguez Lorenzo et al, 2023), una narrativa atractiva que sustente la estrategia híbrida (Torres, 2022) y la ineludible generación de un relato que auspicie, cubra, fortalezca y ampare la zona gris (Hernández-García, 2022); otorgan un gran papel a los marcos cognitivos (Goffman, 2006), la comunicación persuasiva (Candelas, 2023) y opinión pública (Sartori 2007). Estos elementos, aunque subestimados en muchos análisis, son fundamentales para entender cómo la desinformación se inserta en el tejido social y se convierte en una fuerza de cambio, erosionando la confianza en las instituciones y alterando la percepción de la realidad. Entender la relación entre la manipulación cognitiva y los cambios sociales es crucial, ya que, como lo describe Berger y Luckmann (2003), la construcción social de la realidad es un proceso dinámico (externalización, objetivación e internalización) que puede ser fácilmente influenciado por actores con el control sobre los medios (interacción social) y las narrativas (lenguaje).

5. CONSTRUCCIÓN DE NARRATIVAS Y MARCOS

Las narrativas son relatos estructurados que buscan dar sentido a los eventos y moldear la percepción del público. Desde la antigüedad, la propaganda se ha basado en la construcción de relatos que moldean la percepción pública. Se ha descrito cómo se crean "ilusiones necesarias"[11] para que ciertos grupos de poder mantengan su influencia sobre la sociedad (Herman & Chomsky, 1988). En el contexto de la desinformación moderna, las narrativas son diseñadas no solo para convencer, sino para arraigar creencias que son difíciles de erradicar incluso cuando se exponen como falsas[12]. Flynn, Nyhan y Reifler (2017) identifican que las percepciones erróneas políticas no son simples fallos de información, si no que se deben a percepciones erróneas (creencias falsas o infundadas sostenidas con confianza y con resistencia a la corrección), a factores individuales (como los sesgos cognitivos o las identidades partidistas o ideológicas) y a la resistencia al cambio (pasee a la constatación de información falsa o procesos de verificación o fact-checking); pero también entorno al mediático y político (facilitando la exposición selectiva a fuentes).

Estas narrativas, una vez instauradas, pueden seguir ejerciendo un efecto duradero debido a la inercia cognitiva y la resistencia al cambio de las creencias establecidas (Libicki, 2021; Flynn, Nyhan, & Reifler, 2017). Las narrativas falsas y altamente engañosas tienden a prevalecer debido a su capacidad para explotar las emociones humanas, como el miedo y la indignación moral, lo que aumenta su impacto y difusión en redes sociales (Pennycook & Rand, 2021).

El concepto de "marco" o framing se refiere a las estructuras cognitivas que determinan cómo interpretamos y comprendemos la información. Estos marcos actúan como atajos mentales que organizan la información y nos permiten interpretar los hechos según esquemas previos de significado. La teoría de los marcos cognitivos destaca cómo las estructuras de interpretación que utiliza la sociedad para dar sentido a los eventos pueden ser manipuladas a través de la comunicación persuasiva (Goffman, 2006). La disputa por el control de estos marcos se ha convertido en un elemento central en la lucha contra la desinformación, el framing no solo busca combatir las falsedades, sino también establecer marcos alternativos que reconfiguren el debate público (Tuñón Navarro, Oleart, & Bouza García, 2019). En el contexto de las estrategias híbridas, y por extensión del dominio cognitivo, los marcos son utilizados para enfocar la atención del público en ciertos aspectos de la realidad mientras se ocultan o distorsionan otros[13]. Este proceso permite que ciertos relatos prevalezcan, no por su veracidad, sino por la manera en que se presentan y contextualizan. Este proceso es clave para mantener el control narrativo y evitar que se cuestionen las premisas fundamentales de las acciones emprendidas en un conflicto (Colom, 2018).

En la práctica moderna, el framing se ha convertido en una herramienta clave no solo para moldear la interpretación de los eventos, sino también para influir en las emociones del público, explotando sesgos cognitivos que dificultan la reflexión crítica (Astorga González, 2020).

5.1. IMPLEMENTACIÓN

La construcción de narrativas y marcos en el contexto de la desinformación implica un proceso complejo donde se crean relatos y estructuras cognitivas diseñadas para influir en la percepción pública de manera profunda y duradera. Este proceso se basa en una comprensión avanzada de las ciencias del comportamiento, donde se explotan sesgos cognitivos como el de anclaje, la disponibilidad y la confirmación para asegurar que las narrativas construidas sean resistentes al cambio (Astorga González, 2020). La sofisticación en la construcción de estas narrativas emplea la capacidad para combinar hechos reales con distorsiones sutiles, haciendo que sean más difíciles de desacreditar y más fáciles de aceptar por la audiencia (Rid, 2021). De esta manera, las narrativas, que explotan los sesgos cognitivos y emocionales del público, se estructuran para ser simplificadas y emocionales, lo que aumenta su efectividad en la manipulación mediática (Herman & Chomsky, 1988). Estas narrativas no solo buscan convencer, sino también establecer una percepción de la realidad resistente a la corrección, incluso cuando se expone su falsedad[14]. La exposición repetida a noticias falsas aumenta su credibilidad percibida, incluso cuando estas son inicialmente plausibles. Este efecto, conocido como la "ilusión de verdad", juega un papel crucial en la permanencia y aceptación de las narrativas falsas (Pennycook et al, 2021).

Además, el microtargeting o segmentación de la población según sus creencias y valores ha permitido que los mensajes se adapten específicamente a cada grupo, unido a la proliferación de medios y canales alternativos (y en ocasiones opacos a la mayoría de la población y a la opinión pública) ha amplificado la capacidad de estos marcos para influir en la percepción pública aumentando la efectividad de la manipulación (Astorga González, 2020). Este enfoque personalizado en la difusión de desinformación permite maximizar el impacto en diferentes segmentos de la sociedad, fomentando la polarización y reforzando creencias preexistentes mientras que dificulta su detección (Maggioni y Magri, 2015).

El impacto de estas narrativas y marcos es tal que, incluso cuando se desacreditan, pueden seguir influyendo en la opinión pública debido a la inercia cognitiva, un fenómeno en el que las creencias previamente establecidas son resistentes al cambio (Libicki, 2021). Esto es particularmente evidente en la manera en que ciertos marcos narrativos persisten en el discurso público mucho después de que se ha demostrado su falsedad, continuando su influencia en la percepción y la acción social (Juurvee y Mattiisen, 2020). De este modo, la construcción de narrativas y marcos se convierte en una herramienta poderosa para moldear la percepción pública y mantener el control sobre la interpretación de la realidad.

5.2. IMPACTO DE LAS NARRATIVAS Y LOS MARCOS EN EL DOMINIO COGNITIVO

Las narrativas y los marcos tienen un impacto profundo en el dominio cognitivo, moldeando no solo cómo se perciben los eventos, sino también cómo se entienden y recuerdan. Se ha destacado que la creación de un relato malintencionado puede ser explotado en beneficio de aquellos que controlan la narrativa, otorgando un gran poder a los marcos cognitivos y la comunicación persuasiva (Rodríguez Lorenzo et al, 2023; Torres, 2022). Estos elementos son fundamentales para entender cómo la desinformación se inserta en el tejido social y se convierte en una fuerza de cambio, erosionando la confianza en las instituciones y alterando la percepción de la realidad. Además, estos marcos no solo influyen en la percepción individual, sino que también afectan la memoria colectiva, condicionando la forma en que las sociedades recuerdan y aprenden de los eventos históricos, lo cual puede tener repercusiones a largo plazo en la cohesión social y en la formación de identidades nacionales (Aznar Fernández-Montesinos, 2021). La propaganda y la desinformación no solo operan a través de mensajes directos, sino que también configuran el entorno cognitivo en el que se interpretan estos mensajes, creando un ambiente de incertidumbre y desconfianza que facilita la manipulación de la opinión pública (Lupiáñez Lupiáñez, 2023).

La manipulación cognitiva ha demostrado ser capaz de alterar no solo la percepción inmediata de la realidad, sino también de configurar patrones de pensamiento y comportamiento a largo plazo (Astorga González, 2020). El impacto de estas narrativas en el dominio cognitivo se amplifica con el uso de tecnologías de la información que permiten una difusión rápida y masiva, lo que hace que los efectos de la desinformación sean más duraderos y difíciles de contrarrestar (Lupiáñez Lupiáñez, 2023).

6. EVOLUCIÓN DE LA DESINFORMACIÓN

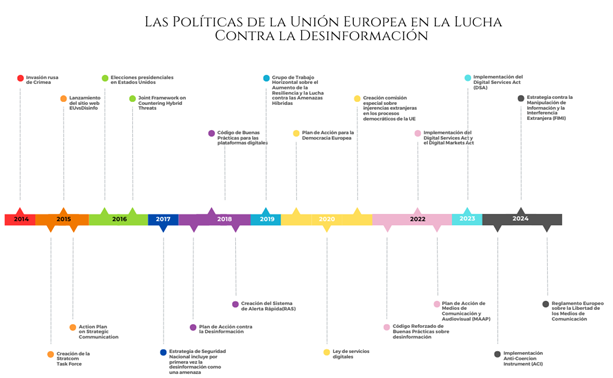

La UE ha implementado un conjunto de políticas y acciones coordinadas para combatir la desinformación, reconociendo su impacto significativo en la estabilidad democrática y la seguridad de los Estados miembros. La relevancia de esta amenaza se intensificó tras eventos como la invasión rusa de Crimea en 2014 y las elecciones presidenciales en Estados Unidos de 2016, que evidenciaron cómo la desinformación podía ser utilizada como una herramienta eficaz en los conflictos híbridos y en la injerencia electoral (EEAS, 2015). Puede observarse los principales hitos en la Figura 2[15].

Figura 2

Fuente: Elaboración propia.

En España la percepción de la desinformación ha evolucionado significativamente en las últimas décadas, a partir de la segunda mitad de la década de 2010, marcada por un creciente reconocimiento de los riesgos asociados a la circulación de información falsa y manipulada, tanto a nivel nacional como internacional (Badillo y Arteaga, 2024).

La polarización política en España, acentuada por el conflicto en Cataluña y la creciente fragmentación del espectro político, ha sido un factor relevante en la percepción de la desinformación (Badillo y Arteaga, 2024). El 60% de los españoles percibían una gran división política en el país, y más del 70% consideraba que la desinformación estaba contribuyendo significativamente a esta división (CIS, 2021).

La confianza de los españoles en los medios de comunicación continúa siendo baja (por debajo del 5 sorbe 10)[16], mientras que la influencia de las redes sociales aumenta[17](CIS, 2024). El Índice de Confianza en los Medios, elaborado por Eurobarómetro, muestra una desconfianza significativa de los españoles. El 40% de los encuestados en España no confiaba en los medios tradicionales, 12 puntos más que la media europea y el 58% creen que los medios proporcionan información sometida a presiones políticas o comerciales, 15 puntos más que la media europea (Eurobarómetro, 2024).

La digitalización y la penetración de las redes sociales han jugado un papel crucial en la evolución de la percepción de la desinformación. Según el Digital Economy and Society Index (DESI) de 2024, España ha experimentado un aumento constante en el uso de internet y redes sociales. El DESI indica que, en 2024, el 96.45% de los hogares españoles tenía acceso a internet, el 88.23% de la población tiene habilidades digitales superiores[18] y el 34.4% de las empresas utilizan varias redes sociales (frente al 28.5% de la media europea (DESI, 2020). Este alto nivel de conectividad ha incrementado la exposición de la población a campañas de desinformación. La creciente importancia de las redes sociales como el principal canal de acceso a la información[19], especialmente entre los jóvenes[20], sugiere un alejamiento de los formatos de noticias tradicionales y una preferencia por contenidos visuales y breves (Reuters Institute for the Study of Journalism, 2024).

Finalmente, el contexto global también ha influido en la percepción de la desinformación en España. Por ejemplo, la pandemia de COVID-19, desencadenó una "infodemia", un término acuñado por la Organización Mundial de la Salud para describir la sobreabundancia de información, tanto precisa como inexacta, que dificultó a las personas encontrar fuentes confiables (OMS,2020). Durante la pandemia, la red Latam Chequea verificó más de 1.000 noticias falsas relacionadas con la COVID-19 en España, muchas de las cuales se propagaron ampliamente en redes sociales y aplicaciones de mensajería (Latam Chequea, 2022). Este fenómeno exacerbó la desconfianza pública y desestabilizó aún más el ecosistema informativo, subrayando la necesidad de fortalecer las capacidades nacionales para detectar y contrarrestar la desinformación de manera efectiva (OECD (2024). En medio de una creciente desconfianza en los medios tradicionales, afectando al casi el 70% de la población (Novoa-Jaso, Sierra, Labiano, & Vara-Miguel, 2024). Además, un 37% de los españoles evita activamente las noticias, un comportamiento que parece estar motivado por la saturación de contenido negativo o controversial que domina las narrativas mediáticas actuales (Reuters Institute for the Study of Journalism, 2024).

La respuesta institucional de España a la desinformación ha evolucionado de manera significativa desde 2017, cuando el problema fue reconocido por primera vez en la Estrategia de Seguridad Nacional, hasta la implementación de políticas más robustas y coordinadas en los años siguientes. Sin embargo, esta evolución ha estado marcada tanto por avances notables como por algunas carencias en la integración de enfoques más holísticos que incluyan la gestión de narrativas (Adame Hernández, 2024).[21].

7. MEDIDAS Y HERRAMIENTAS ACTUALES PARA COMBATIR LA DESINFORMACIÓN EN ESPAÑA

El núcleo de la infraestructura española para combatir la desinformación se centra en la Comisión Permanente contra la Desinformación, que coordina la respuesta operativa a campañas de desinformación. Esta comisión actúa bajo la supervisión de la Secretaría de Estado de Comunicación, que lidera la política de comunicación estratégica del Gobierno. En situaciones de crisis, la Célula de Coordinación contra la Desinformación gestiona la respuesta, asegurando que las acciones del Gobierno sean rápidas y efectivas (ORDEN PCM/1030/2020, 2020).

El Foro contra las Campañas de Desinformación en el Ámbito de la Seguridad Nacional, ha sido uno de los pilares principales en la estrategia de España contra la desinformación. En 2023, se presentaron siete documentos que abordan diversas facetas del problema, desde metodologías de verificación y prevención (como el prebunking y la teoría de la inoculación[22]) hasta el análisis de la desinformación rusa en el contexto de la guerra en Ucrania. (DSN, 2023b). A finales de 2024, presentaron la segunda edición de trabajos del Foro avanzando en aspectos como el papel que los medios de comunicación y las direcciones de comunicación de instituciones públicas y privadas, FIMI, la relección ente desinformación y discurso del odio e hipótesis de trabajo sobre el ecosistema mediático y de opinión pública español en relación con la desinformación (DSN, 2024b). El Foro canaliza la cooperación público-privada y público-social, articulando un enfoque estratégico y multisectorial. La profundidad de sus análisis, así como los esfuerzos por abordar una realidad compleja, se evidencian con claridad en la evolución de sus respectivas publicaciones.

U otras iniciativas como las campañas de comunicación positiva del Ministerio de Asuntos Exteriores, Unión Europea y Cooperación para combatir la desinformación a través de narrativas verificables[23], el desarrollo de herramientas tecnológicas como ELISA[24] (Estudio Simplificado de Fuentes Abiertas) o el proyecto DANGER (INCIBE. (2024), el Plan de Acción por la Democracia[25] (MPJRC, 2024) o la orden por la que se establece la elaboración de la Estrategia Nacional contra las Campañas de Desinformación (Orden PJC/248/2025, 2025). Cabe señalar la carencia de estudios, memorias o análisis sobre el impacto de las medidas institucionales contra de desinformación.

7.1. PROCEDIMIENTO DE ACTUACIÓN CONTRA LA DESINFORMACIÓN

El Procedimiento de actuación contra la desinformación regulado por la Orden PCM/1030/2020, tiene como propósito fundamental la creación de un marco coordinado para detectar, analizar y responder a la desinformación en España (ORDEN PCM/1030/2020, 2020), particularmente en situaciones que afecten la seguridad nacional. Este procedimiento fue aprobado por el Consejo de Seguridad Nacional y se inscribe en el contexto de las estrategias europeas para combatir la desinformación, particularmente aquellas establecidas en el Plan de Acción contra la Desinformación de la UE de 2018.

El procedimiento se articula en cuatro ejes fundamentales: Detección, análisis, respuesta y evaluación; y en cuatro niveles de activación. La Secretaría de Estado de Comunicación es la encargada de la coordinación general, actuando en estrecha colaboración con otros ministerios, el Centro de Situación del Consejo de Seguridad Nacional y el Grupo de Trabajo contra la Desinformación. Este grupo interministerial es responsable de asesorar y proponer acciones al Consejo de Seguridad Nacional, asegurando una respuesta integrada y coherente[26].

La implementación del procedimiento provocó controversia pública y llevó a que varias organizaciones presentaran recursos y denuncias ante el Contencioso-Administrativo[27]. También ha sido criticado por su falta de claridad en la definición de competencias y campos de actuación de las diferentes autoridades involucradas (Gómez, 2020; Garrós Font & Santos Silva, 2021) o la falta de recursos especializados (Badillo y Arteaga, 2024).

El Tribunal Supremo estableció unos límites muy claros en los trabajos y alcance del "Procedimiento de Actuación contra la Desinformación" y los organismos que crea al establecer que no crea ni otorga nuevas competencias ni puede afectar derechos fundamentales (Tribunal Supremo, 2021). Restringiendo así el protocolo a un plan de actuación interna limitado a establecer criterios de coordinación. Asimismo, establece una definición jurídica de desinformación[28], algo que no hacia el procedimiento.

8. CONCLUSIONES

A lo largo del artículo, se ha analizado cómo la desinformación se halla inserta en un contexto más amplio de tácticas y estrategias geopolíticas, destacado su papel FIMI. Este contexto más amplio se enriquece con la consideración de cómo los marcos narrativos se emplean estratégicamente para orientar el debate público hacia narrativas específicas que favorecen los intereses de quienes los construyen, minimizando o distorsionando aspectos de la realidad que podrían contradecir estos intereses (Tuñón Navarro, Oleart, & Bouza García, 2019; Astorga González, 2020). Se ha expuesto como la desinformación no actúa como una herramienta aislada, sino que forma parte de un conjunto coordinado de acciones diseñadas para influir en la percepción pública, manipular la narrativa y crear incertidumbre en los procesos políticos y sociales (Hoffman, 2009; McCuen, 2008).

La desinformación ha tenido un impacto crítico en eventos clave durante la última década, impactando tanto la estabilidad institucional como la cohesión social. Los análisis han revelado que las políticas públicas en España, aunque han intentado responder a estas amenazas, han sido insuficientes debido a su carácter fragmentado y predominantemente reactivo (Badillo y Arteaga, 2024). Esto ha puesto a las instituciones españolas en una posición vulnerable frente a campañas de desinformación cada vez más sofisticadas, que han explotado las debilidades en la coordinación interinstitucional y la falta de un enfoque preventivo integral (Bennett & Livingston, 2020).

La respuesta institucional a la desinformación ha sido limitada por la falta de integración entre la ciberseguridad y la defensa cognitiva. El anonimato que brindan las plataformas digitales y la posibilidad de operar a través de intermediarios o "proxies" añade una capa de complejidad que dificulta la identificación de los verdaderos perpetradores de estas campañas (Castro Torres, 2021), lo que fomenta la necesidad de una estrategia más proactiva y prospectiva (Arias Gil, 2019). Aunque se han realizado esfuerzos significativos para mejorar la vigilancia y la respuesta a la desinformación, estos han sido fragmentados y carecen de la coherencia necesaria para enfrentar las amenazas de manera efectiva. Valga como ejemplo la ausencia de una Estrategia Nacional de Lucha Contra las Campañas de Desinformación propuesta desde 2022 (DSN, 2022). Esto se ejemplifica claramente en la activación del Nivel 1 del Procedimiento de Actuación contra la Desinformación. En el nivel más bajo de activación del Procedimiento supone la concurrencia de altos organismos del Estado como la Secretaria de Estado de Comunicación, el DSN, el CNI y la Secretaría de Estado de Transformación Digital e Inteligencia Artificial, entre otros (ORDEN PCM/1030/2020, 2020). Así mismo asigna un rol predominantemente reactivo, lo que refuerza la limitada respuesta y alcance institucional.

Otro ejemplo, la construcción de narrativas y marcos por parte de actores malintencionados ha demostrado ser un desafío formidable, ya que estas tácticas no solo distorsionan la realidad, sino que también debilitan la confianza en las instituciones democráticas (Berger & Luckmann, 2003; Candelas, 2023) un elemento poco abordado en la respuesta institucional española, y donde apuestas como la alfabetización digital o los fact-checkers (DSN, 2021) arrojan resultados muy limitados (Pennycook, Bear, Collins, & Rand, 2020; Flynn, Nyhan, & Reifler, 2017). De hecho, las narrativas falsas y altamente engañosas tienden a prevalecer debido a su capacidad para explotar las emociones humanas, como el miedo y la indignación moral, lo que aumenta su impacto y difusión en redes sociales (Pennycook & Rand, 2021).

El análisis de la eficacia de las estrategias propuestas sugiere que un enfoque integral que combine medidas técnicas y cognitivas es fundamental para desarrollar una respuesta eficaz contra la desinformación. Las estrategias actuales, aunque necesarias, no han logrado anticiparse ni responder a las amenazas emergentes debido a su enfoque reactivo (Badillo y Arteaga, 2024) y parcial que no aborda elementos claves del problema como las narrativas. Se hace evidente la necesidad de adoptar una postura más proactiva y prospectiva, que permita a las instituciones no solo responder a las amenazas actuales, sino también anticipar y neutralizar futuras campañas de desinformación (Libicki, 2021).

Una de las iniciativas propuestas por los principales actores es la implementación de tecnologías avanzadas, como la inteligencia artificial y el aprendizaje automático, que pueden desempeñar un papel crucial en la identificación temprana de patrones de desinformación (OTAN, 2021; INCIBE, 2024; DSN, 2024b; Comisión Europea, 2025). Estas tecnologías permiten un análisis en tiempo real de grandes volúmenes de datos, lo que facilita la detección de anomalías que podrían indicar la presencia de campañas coordinadas de desinformación (Rodríguez Lorenzo et al., 2023). Sin embargo, como se ha expuesto a lo largo de este artículo para que estas herramientas sean efectivas, es esencial que se integren en un marco más amplio de defensa institucional, que incluya tanto la ciberseguridad como la defensa cognitiva.

Además de las medidas tecnológicas, la investigación subraya la importancia de fortalecer tanto a la sociedad como a sus instituciones, incrementando su profundidad estratégica y sus capacidades. La lucha contra la desinformación requiere una mayor inversión en recursos económicos, institucionales y humanos (Rodríguez Lorenzo et al., 2023), acorde con la magnitud de la amenaza. Incorporar la lógica de la sociedad híbrida en las propuestas estratégicas y tácticas puede aumentar su efectividad y reducir los costes de inversión en la respuesta (Arias Gil, 2020). Esta lógica permite una mayor adaptación a las amenazas emergentes y una respuesta más eficiente. Es fundamental que España desarrolle capacidades nacionales robustas, especialmente dado que la FIMI no solo involucra a grandes potencias como Rusia y China, sino también a una variedad de actores (Badillo & Arteaga, 2024), para los cuales la respuesta no puede depender exclusivamente de organismos internacionales como la OTAN o la UE.

Es necesario superar el paradigma que se enfoca en el fomento del pensamiento crítico y la alfabetización mediática y avanzar hacia el concepto similar al propuesto por Arias Gil de “ciudadano estratégico” (2020). Este nuevo enfoque implica transformar la lógica de responsabilidad individual, que es pasiva, atomizada, parcial y de desarrollo a medio/largo plazo; en una respuesta social más proactiva, colectiva y coordinada. En lugar de depender únicamente de la formación individual en habilidades críticas, el ciudadano estratégico es un recurso colectivo, proactivo, descentralizado (pero coordinado) que puede actuar rápidamente frente a las amenazas de desinformación. Este cambio de enfoque podría permitir una respuesta más dinámica y eficaz, abordando las amenazas desde el corto plazo y facilitando una mayor adaptación a las tácticas cambiantes de los actores de desinformación.

Una recomendación clave es la necesidad de realizar entrenamientos, simulaciones y maniobras específicas en el ámbito de la desinformación, similares a las que se realizan en otros ámbitos de la seguridad y la defensa. Propuesta ausente en toda la documentación analizada con anterioridad. Estas actividades permitirían a las instituciones estar mejor preparadas para identificar y neutralizar campañas de desinformación antes de que estas causen un daño significativo. Además, se propone un cambio hacia una postura más proactiva (uso de comunicación estratégica) y prospectiva, que permita identificar los posibles vectores de ataque y tomar medidas preventivas para minimizarlos, neutralizarlos o mitigarlos antes de que se conviertan en amenazas reales. Esto incluye incorporar la lógica asimétrica propia de la sociedad híbrida, donde las respuestas tácticas y estratégicas pueden ser más efectivas y menos costosas (Arias Gil, 2020).

Finalmente, la creación de estructuras más densas y coordinadas en la lucha contra la desinformación se presenta como una medida esencial. Esto incluye la capacitación de mandos intermedios en la administración pública, el sector privado y la sociedad civil, especialmente en áreas relacionadas con la comunicación, la prospectiva y el análisis sociopolítico. Esta formación es crucial para asegurar que todos los sectores de la sociedad estén alineados y preparados para enfrentar las complejas amenazas que plantea la desinformación (DSN, 2022). En este sentido, la disputa por el control de los marcos narrativos se ha convertido en un elemento central en la lucha contra la desinformación, donde no solo se busca combatir las falsedades, sino también establecer marcos alternativos que reconfiguren el debate público (Tuñón Navarro, Oleart, & Bouza García, 2019). De igual modo conocer, eliminar, mitigar o neutralizar las vulnerabilidades culturales, políticas o sociales propias es clave para eliminar vectores de ataque, reducir las vulnerabilidades y aumentar la residencia.

En conclusión, hay una necesidad de un cambio significativo en la forma en que España aborda la desinformación. No basta con implementar medidas técnicas o reactivas; es indispensable desarrollar una estrategia integral que fortalezca los aspectos sociales, cognitivos y tecnológicos, promoviendo una defensa más coordinada, proactiva y adaptativa frente a las amenazas de desinformación en un entorno híbrido global cada vez más dinámico y complejo.

9. REFERENCIAS BIBLIOGRÁFICAS

Adame Hernández, J. F. (2024). España frente a la desinformación: Desafíos híbridos y respuestas convencionales (Trabajo fin de máster, Centro Universitario de la Guardia Civil).

Alastuey Rivas, J., García López, M. I., García Vizcaíno, F., Garrido López, A., Mora Moret, F., Pedrazo Majarrez, J. M., & Pérez-Tejada García, S. (2024). La desinformación como arma de guerra. Documento de Opinión IEEE 26/2024. Instituto Español de Estudios Estratégicos (IEEE). Recuperado de https://www.ieee.es/Galerias/fichero/docs_opinion/2024/DIEEEO26_2024_VVAA_Desinforma (consultado 06/04/2025).

Allcott, H., & Gentzkow, M. (2017). Social media and fake news in the 2016 election. Journal of Economic Perspectives, 31(2), 211-236. https://doi.org/10.1257/jep.31.2.211(consultado 06/04/2025).

Allenby, B., & Garreau, J. (2017, January 3). Weaponized narrative is the new battlespace. Defence One. Recuperado de http://bit.ly/3XyiwB2 (consultado 14/08/2024).

Althusser, L. (1971). Ideología y aparatos ideológicos de Estado. Medellín: La Oveja Negra. Recuperado de https://lobosuelto.com/wp-content/uploads/2018/10/Althusser-L.-Ideolog%C3%ADa-y-aparatos-ideol%C3%B3gicos-de-estado.-Freud-y-Lacan-1970-ed.-Nueva-Visi%C3%B3n-1974.pdf (consultado 14/08/2024).

Arias Gil, E. (2020). Insurgencia low-cost: una amenaza asimétrica emergente. Recuperado de https://canal.uned.es/video/5f6b02325578f274ac7a0632 (consultado 06/04/2025).

Arias Gil, E. (2021). La dimensión emergente de las fake news: La guerra centrada en red y la guerra memética. Recuperado de LA DESINFORMACIÓN COMO SOPORTE DE LAS NARRATIVAS. Jornadas académicas informativas. Memoria. Instituto para el Desarrollo de la Inteligencia en el Ámbito del Terrorismo, Seguridad y Defensa (IDITESDE). https://www.minervainstitute.es/wp-content/uploads/2024/03/IDIT-URJC-1.pdf (consultado 14/08/2024).

Arteaga, Félix (2020). La lucha contra la desinformación: cambio de modelo. Real Instituto Elcano. https://www.realinstitutoelcano.org/comentarios/la-lucha-contra-la-desinformacion-cambio-de-modelo (consultado 06/04/2025).

Astorga González, L. (2020). Manipulación cognitiva en el siglo XXI. Revista del Instituto Español de Estudios Estratégicos, 16, 15-44. Recuperado de https://revista.ieee.es/article/view/2208 (consultado 06/04/2025).

Aznar Fernández-Montesinos, F. (2021). La batalla de las narrativas. Recuperado de LA DESINFORMACIÓN COMO SOPORTE DE LAS NARRATIVAS. Jornadas académicas informativas. Memoria. Instituto para el Desarrollo de la Inteligencia en el Ámbito del Terrorismo, Seguridad y Defensa (IDITESDE). https://www.minervainstitute.es/wp-content/uploads/2024/03/IDIT-URJC-1.pdf (consultado 14/08/2024).

Badillo, Á. M., & Arteaga, F. (2024). El impacto estratégico de la desinformación en España. Informe Iberifier. Recuperado de https://media.realinstitutoelcano.org/wp-content/uploads/2024/04/informe-iberifier-el-impacto-estratagico-de-la-desinformacion-en-espana.pdf (consultado 06/04/2025).

BBC Mundo (16 de febrero de 2018). El Departamento de Justicia de Estados Unidos acusa a 13 ciudadanos rusos de interferir en las presidenciales de 2016. https://www.bbc.com/mundo/noticias-internacional-43092239 (consultado 04/04/2025).

Bennett, W. L., & Livingston, S. (2020). The disinformation order: Disruptive communication and the decline of democratic institutions. European Journal of Communication. Recuperado de https://iddp.gwu.edu/sites/g/files/zaxdzs5791/files/downloads/The%20Disinformation%20Order%3B%20Livingston.pdf (consultado 14/08/2024).

Berger, P. L., & Luckmann, T. (1966). La construcción social de la realidad. Buenos Aires. Recuperado de https://redmovimientos.mx/wp-content/uploads/2020/07/La-Construcci%C3%B3n-Social-de-la-Realidad-Berger-y-Luckmann.pdf (consultado 06/04/2025).

Burkhardt, J. M. (2017). History of fake news. Library Technology Reports, 53(8), 5-9. https://journals.ala.org/index.php/ltr/article/view/6497/8631 (consultado 06/04/2025).

Buvarp, P. M. H. (2021). The space of influence: Developing a new method to conceptualise foreign information manipulation and interference on social media. The Norwegian Defence Research Establishment (FFI). Recuperado de https://www.ffi.no/en/publications-archive/the-space-of-influence-developing-a-new-method-to-conceptualise-foreign-information-manipulation-and-interference-on-social-media (consultado 02/06/2025).

Calvo Albero, J. L. (18 de diciembre de 2017). Desinformación: viejas ideas en nuevos formatos. Global Strategy. https://global-strategy.org/desinformacion-viejas-ideas-en-nuevos-formatos (consultado 06/04/2025).

Calvo, J. L. (abril, 2023). De la guerra silenciosa a la guerra híbrida. Revista Española de Defensa. https://www.defensa.gob.es/Galerias/gabinete/red/2023/04/p-54-57-red-404-desinformacion.pdf (consultado 06/04/2025).

Candelas, M. (2023). La propaganda en los conflictos geopolíticos: de la guerra psicológica a la guerra más allá de los límites. Documento de Opinión IEEE 02/2023. https://www.ieee.es/Galerias/fichero/docs_opinion/2023/DIEEEO02_2023_MIGCAN_Propaganda.pdf (consultado 06/04/2025).

Caridad-Sebastián, M, Morales-García, A. M., Martínez-Cardama, S, & García López, F (2018). Infomediación y posverdad: el papel de las bibliotecas (Infomediation and post-truth: The role of libraries). https://e-archivo.uc3m.es/bitstream/handle/10016/28096/Infomediacion_EPI_2018.pdf?sequence=1&isAllowed=y (consultado 20/08/2024).

Castro Torres, J. I. (2021). El entorno de la desinformación y la construcción de las narrativas. Recuperado de LA DESINFORMACIÓN COMO SOPORTE DE LAS NARRATIVAS. Jornadas académicas informativas. Memoria. Instituto para el Desarrollo de la Inteligencia en el Ámbito del Terrorismo, Seguridad y Defensa (IDITESDE). https://www.minervainstitute.es/wp-content/uploads/2024/03/IDIT-URJC-1.pdf [URL no disponible] (consultado 14/08/2024).

CCN-CERT. (2019, noviembre 11). ELISA: Nueva herramienta de cibervigilancia del CCN-CERT. Recuperado de https://administracionelectronica.gob.es/pae_Home/pae_Actualidad/pae_Noticias/Anio-2019/Noviembre/Noticia-2019-11-11-ELISA-nueva-herramienta-de-cibervigilancia-del-CCN-CERT.html?idioma=es (consultado 06/04/2025).

Centro de Investigaciones Sociológicas (CIS). (2021). Barómetro CIS de febrero-julio de 2022. Madrid, España. Recuperado de https://www.cis.es/documents/d/cis/es3351marpdf (consultado 14/08/2024).

Centro de Investigaciones Sociológicas (CIS). (2023). Estudio 3424: Percepción social de aspectos científicos de la manipulación genética y biotecnología. Recuperado de https://www.cis.es/es/detalle-ficha-estudio?origen=estudio&codEstudio=3424 (consultado 14/08/2024).

Centro de Investigaciones Sociológicas (CIS). (2024). Estudio 3486: Encuesta sobre Tendencias Sociales (IV). Recuperado de https://www.cis.es/visor?migrado=false&fichero=cru3486_enlace (consultado 01/06/2025).

Chan, R. (2020). The Cambridge Analytica whistleblower explains how the firm used Facebook data to sway elections. https://www.businessinsider.com/cambridge-analytica-whistleblower-christopher-wylie-facebook-data-2019-10 (consultado 06/04/2025).

Chomsky, N. (1992). Ilusiones necesarias. Recuperado de https://resistir.info/livros/chomsky_ilusiones_necesarias.pdf (consultado 06/04/2025)

Clausewitz, C. von. (1976). De la guerra. Esfera de los Libros. Recuperado de https://www.esferalibros.com/wp-content/uploads/2022/09/De-la-guerra-primeras.pdf (consultado 14/08/2024).

Colom, G. (2018). Guerras híbridas. Cuando el contexto lo es todo. Revista Ejército. Recuperado de https://www.ugr.es/~gesi/Guerras-hibridas.pdf (consultado 20/08/2024).

Colom, G. (2018b). La doctrina Gerasimov y el pensamiento estratégico ruso contemporáneo. Revista del Ejército. Recuperado de https://www.thiber.org/2019/05/11/la-doctrina-gerasimov-y-el-pensamiento-estrategico-ruso-contemporaneo (consultado 06/04/2025).

Comisión Europea. (2022). The Strengthened Code of Practice on Disinformation. Recuperado de https://ec.europa.eu/newsroom/dae/redirection/document/87585 (consultado 20/08/2024).

Comisión Europea. (2024, 17 de diciembre). La Comisión incoa un procedimiento formal contra TikTok sobre los riesgos electorales en virtud de la Ley de Servicios Digitales Recuperado de https://ec.europa.eu/commission/presscorner/detail/es/ip_24_6487 (consultado 22/03/2025).

Comisión Europea. (2025, 15 de abril). La Comisión invierte 140 millones de euros para desplegar tecnologías digitales clave. Recuperado de https://spain.representation.ec.europa.eu/noticias-eventos/noticias-0/la-comision-invierte-140-millones-de-euros-para-desplegar-tecnologias-digitales-clave-2025-04-15_es#:~:text=La%20Comisi%C3%B3n%20ha%20lanzado%20cuatro,y%20luchar%20contra%20la%20desinformaci%C3%B3n (consultado 22/03/2025).

Dahlgren, P. (2018). Media, knowledge and trust: The deepening epistemic crisis of democracy. Javnost - The Public, 25(1–2), 20–27. Recuperado de https://doi.org/10.1080/13183222.2018.1418819 (consultado 06/04/2025).

Davis, G. (2005). The ideology of the visual. In M. Rampley (Ed.), Exploring visual culture: Definitions, concepts, contexts (pp. 163-178). Edinburgh University Press.

DESI dashboard for the Digital Decade. (2024). DESI dashboard for the Digital Decade. Comisión Europea. Recuperado de https://digital-decade-desi.digital-strategy.ec.europa.eu/datasets/desi/charts (consultado 06/04/2025).

DSN. (2021). Estrategia de Seguridad Nacional. Departamento de Seguridad Nacional (2021).

DSN. (2022). Departamento de Seguridad Nacional. (2022). Recuperado de https://www.dsn.gob.es/sites/default/files/documents/LibroDesinfoSN.pdf (consultado 14/08/2024).

DSN. (2023a). Foro contra las Campañas de Desinformación en el ámbito de la Seguridad Nacional - Trabajos 2023. Recuperado de https://www.dsn.gob.es/sites/dsn/files/Foro%20Campa%C3%B1as%20Desinfo%20GT%202023%20Accesible.pdf (consultado 14/08/2024).

DSN. (2023b). Presentación de trabajos 2023: Foro contra campañas de desinformación en el ámbito de la seguridad nacional. Recuperado de https://www.dsn.gob.es/es/actualidad/sala-prensa/presentaci%C3%B3n-trabajos-2023-foro-contra-campa%C3%B1as-desinformaci%C3%B3n-%C3%A1mbito (consultado 14/08/2024).

DSN. Departamento de Seguridad Nacional. (2024). Informe Anual de Seguridad Nacional 2023. Gobierno de España. Recuperado de https://www.newtral.es/wp-content/uploads/2024/03/IASN2023_0.pdf (consultado 14/08/2024).

DSN. Departamento de Seguridad Nacional. (2024b). Trabajos del Foro contra las Campañas de Desinformación - Iniciativas 2024. Recuperado de https://www.dsn.gob.es/es/publicaciones/otras-publicaciones/trabajos-foro-contra-campanas-desinformacion-iniciativas-2024#:~:text=medios%20de%20comunicaci%C3%B3n.-,Trabajos%20del%20Foro%20contra%20las%20Campa%C3%B1as%20de%20Desinformaci%C3%B3n%20%2D%20Iniciativas%202024,-Accesible (consultado 14/08/2024).

Donoso Rodríguez, D. (2020). Implicaciones del ámbito cognitivo en

las operaciones militares. Revista IEEE, 01/2020. Recuperado de https://emad.defensa.gob.es/Galerias/CCDC/files/IMPLICACIONES_DEL_AMBITO_COGNITIVO_EN_LAS_OPERACIONES_MILITARES.pdf

(consultado 01/06/2025).

Dubois, E., & Blank, G. (2018). The echo chamber is overstated: the

moderating effect of political interest and diverse media. Information,

Communication & Society. Recuperado de https://www.tandfonline.com/doi/full/10.1080/1369118X.2018.1428656#abstract

(consultado 06/04/2025).

EEAS (European External Action Service). (2024). 2nd report on FIMI threats - January 2024. Recuperado de https://www.eeas.europa.eu/sites/default/files/documents/2024/EEAS-2nd-Report%20on%20FIMI%20Threats-January-2024_0.pdf (consultado 14/08/2024).

EEAS, European External Action Service. (2015). Tackling disinformation, foreign information manipulation & interference. https://www.eeas.europa.eu/eeas/tackling-disinformation-foreign-information-manipulation-interference_en (consultado 14/08/2024).

ENISA & SEAE. (2022). Foreign Information Manipulation and Interference (FIMI) and Cybersecurity – Threat Landscape. Recuperado de https://www.cde.ual.es/wp-content/uploads/2022/12/EEAS-ENISA-Disinformation_Misinformation.pdf (consultado 14/08/2024).

Eurobarómetro. (2024). EUROBARÓMETRO STANDARD 102 Opinión pública en la Unión Europea. Comisión Europea. Recuperado de https://europa.eu/eurobarometer/surveys/detail/3215 (consultado 14/08/2024).

FIP, Federación Internacional de Periodistas. (2018). ¿Qué son las fake news? Guía para combatir la desinformación en la era de posverdad. Recuperado de https://www.ifj.org/fileadmin/user_upload/Fake_News_-_FIP_AmLat.pdf (consultado 06/04/2025).

Flores, J. M. (2022). “Las fake news siempre han existido, pero hoy en día se han visto catapultadas por las redes sociales”. Recuperado de https://www.ucm.es/otri/noticias-las-fake-news-siempre-han-existido-pero-hoy-en-dia-se-han-visto-catapultadas-por-las-redes-sociales (consultado 20/08/2024).

Flynn, D., Nyhan, B., & Reifler, J. (2017). La naturaleza y los orígenes de las percepciones erróneas: comprender las creencias falsas e infundadas sobre la política. Political Psychology, 38(6), 1053-1077. https://doi.org/10.1111/pops.12394 (consultado 06/04/2025).

Foucault, M. (1972). La arqueología del saber. Siglo XXI Editores. Recuperado de https://monoskop.org/images/b/b2/Foucault_Michel_La_arqueologia_del_saber.pdf

(consultado 14/08/2024).

Garrós Font, I., & Santos Silva, M. F. (2021). La lucha contra la infodemia: Análisis del procedimiento de actuación contra la desinformación. Revista de Comunicación y Salud, 11(2), 75-89. https://doi.org/10.35669/rcys.2021.11(2).75-89

Gelfert, Axel. (2018). Fake News: A Definition. Informal Logic, 38. Recuperado de https://informallogic.ca/index.php/informal_logic/article/view/5068 (consultado 06/04/2025).

Goffman, E. (2006). Frame analysis: Los marcos de la experiencia. Centro de Investigaciones Sociológicas.

Gómez, A. (2020, 19 de noviembre). El nuevo procedimiento de actuación contra la desinformación: La polémica está servida. Blog de Propiedad Intelectual y NNTT Garrigues. Recuperado de https://blogip.garrigues.com/publicidad/el-nuevo-procedimiento-de-actuacion-contra-la-desinformacion-la-polemica-esta-servida (consultado 06/04/2025).

Hafen, R. (2024). El arte operacional chino: La primacía de la dimensión humana. Military Review. Recuperado de https://www.armyupress.army.mil/Portals/7/military-review/Archives/Spanish/Q2-2024/Hafen-SPA-Q2-2024/Hafen-SPA-Q2-2024-UA.pdf (consultado 14/08/2024).

Herman, E. S., & Chomsky, N. (1988). Los guardianes de la libertad. Recuperado de https://www.labiblioteca.mx/llyfrgell/1783.pdf (consultado 06/04/2025).

Hernández-García, L. A. (2022). La zona gris: una aproximación conceptual desde las FAS. Recuperado de https://www.atalayar.com/opinion/luis-hernandez-garcia-ieee/la-zona-gris-una-aproximacion-conceptual-desde-las-fas/20220412121331136376.html (consultado 06/04/2025).

Hoffman, F. (2009). Hybrid warfare and challenges. Small Wars Journal. Recuperado de https://smallwarsjournal.com/documents/jfqhoffman.pdf (consultado 06/04/2025).

INCIBE. (2024). DANGER: Ciberseguridad para la detección, análisis y filtrado de contenidos falsos o maliciosos en entornos de hiperconectividad. Recuperado de https://www.incibe.es/node/521663 (consultado 06/04/2025).

Jamieson, K. H., & Cappella, J. N. (2008). Echo chamber: Rush Limbaugh and the conservative media establishment. Oxford University Press.

Jordán, J. (2018). El conflicto internacional en la zona gris: una propuesta

teórica desde la perspectiva del realismo ofensivo. Revista Española de Ciencia

Política, No. 48. Recuperado de https://www.ugr.es/~jjordan/Conflicto-zona-gris.pdf

(consultado 20/08/2024).

Juurvee, I., & Mattiisen, M. (agosto de 2020). The bronze soldier crisis of 2007: Revisiting an early case of hybrid conflict. International Centre for Defence and Security. Recuperado de https://bit.ly/3iRyeZe (consultado 06/04/2025).

Latam Chequea. (2022). Noticias falsas sobre la COVID-19 verificadas por la red Latam Chequea. Recuperado de https://chequeado.com/investigaciones/como-la-desinformacion-sobre-covid-19-infecto-a-america-latina (consultado 14/08/2024).

Lazer, D. M. J., Baum, M. A., Benkler, Y., Berinsky, A. J., Greenhill, K. M., Menczer, F., ... & Rothschild, D. (2018). The science of fake news: A research agenda. Science, 359(6380), 1094-1096. Recuperado de https://doi.org/10.1126/science.aao2998 (consultado 14/08/2024).

Libicki, M. C. (2021). Cyberspace in Peace and War. Naval Institute Press. Recuperado de https://www.researchgate.net/publication/343399173_Military_Operations_in_Cyberspace (consultado 06/04/2025).

Lupiáñez Lupiáñez, M. (2023). Cómo hacer frente a un ataque cognitivo: Prototipo de detección de la propaganda y manipulación en operaciones psicológicas dirigidas a civiles durante un conflicto. Revista del Instituto Español de Estudios Estratégicos, (22), 61-93. Recuperado de https://revista.ieee.es/article/view/6058 (consultado 14/08/2024).

MAEUEC, Ministerio de Asuntos Exteriores, Unión Europea y Cooperación. (2021). Estrategia de Acción Exterior 2021-2024. Recuperado de https://www.exteriores.gob.es/estrategia2021-2024.pdf (consultado 14/08/2024).

Maggioni, M., & Magri, P. (2018). Twitter and Jihad: The Communication Strategy of ISIS. Journal of Cyberspace Studies, 2(2), 239-241. Recuperado de https://doi.org/10.22059/jcss.2018.66728 (consultado 14/08/2024).

Maldita.es. (2023). ¿Qué es el prebunking? Así actúa esta técnica contra la desinformación antes de que se difunda. Recuperado de https://maldita.es/nosotros/20230323/prebunking-que-es-antes-desmentido (consultado 06/04/2025).

Marchal González, A. N. (2023). La necesidad de un nuevo tipo delictivo: La desinformación como una amenaza para el orden público. Boletín Criminológico, 1(2023), 1-14. Recuperado de https://revistas.uma.es/index.php/boletin-criminologico/article/view/17222/17250 (consultado 06/04/2025).

Martín Renedo, S. (2022). Las Zonas Grises sobre el terreno. ¿El fin de las guerras convencionales? Documento de Opinión IEEE 93/2022. Recuperado de https://www.ieee.es/Galerias/fichero/docs_opinion/2022/DIEEEO93_2022_SAUMAR_Zonas.pdf (consultado 06/04/2025).

Mayoral, J, Parratt, S, & Morata, M. (2019). Desinformación, manipulación y credibilidad periodísticas: una perspectiva histórica. Historia y Comunicación Social, 24(2), 395-409. Recuperado de https://revistas.ucm.es/index.php/HICS/article/view/66267 (consultado 06/04/2025).

McCuen, J. (2008). Hybrid Wars. Military Review, 88(2), 107-113. Recuperado de https://www.armyupress.army.mil/Portals/7/military-review/Archives/English/MilitaryReview_20080430_art017.pdf (consultado 06/04/2025).

McIntyre, L. (2018). Posverdad. Madrid: Cátedra.

MPJRC. Ministerio de la Presidencia, Justicia y Relaciones con las Cortes. (2024). Plan de acción por la democracia. Recuperado de https://www.mpr.gob.es/prencom/notas/Documents/2024/2024-3002_Plan_de_accion.pdf (consultado 06/04/2025).

Newtral. (2022). El Mundial de fútbol de Catar, un escaparate para los bulos y la desinformación. Recuperado de https://www.newtral.es/bulos-mundial-catar/20221203 (consultado 06/04/2025).

Novoa-Jaso, M. F., Sierra, A., Labiano, R., & Vara-Miguel, A. (2024). Digital News Report España 2024. Calidad periodística y pluralidad: Claves para la confianza informativa en la era de la inteligencia artificial (IA). Servicio de Publicaciones de la Universidad de Navarra. Recuperado de https://www.unav.edu/documents/98033082/0/DNR_2024.pdf (consultado 14/08/2024).

OECD (2024), Hechos frente a falsedades: Fortaleciendo la democracia a través de la integridad de la información, OECD. Publishing, Paris. Recuperado de https://doi.org/10.1787/06f8ca41-es (consultado 14/08/2024).

Olmo, J. A. (2019). Desinformación: concepto y perspectivas. Real Instituto Elcano. Recuperado de https://www.realinstitutoelcano.org/analisis/desinformacion-concepto-y-perspectivas (consultado 06/04/2025).

OMS, World Health Organization. (2020). Managing the COVID-19 infodemic: Promoting healthy behaviours and mitigating the harm from misinformation and disinformation. Recuperado de https://www.who.int/news/item/23-09-2020-managing-the-covid-19-infodemic-promoting-healthy-behaviours-and-mitigating-the-harm-from-misinformation-and-disinformation (consultado 14/08/2024).

Orden PCM/1030/2020, de 30 de octubre, por la que se publica el Procedimiento de actuación contra la desinformación aprobado por el Consejo de Seguridad Nacional. (2020). Boletín Oficial del Estado. Recuperado de https://www.boe.es/buscar/doc.php?id=BOE-A-2020-13663 (consultado 14/08/2024).

Orden PJC/248/2025, de 13 de marzo, por la que se publica el Acuerdo del Consejo de Seguridad Nacional de 28 de enero de 2025, por el que se aprueba el procedimiento para la elaboración de la Estrategia Nacional contra las Campañas de Desinformación. (2025). Boletín Oficial del Estado. Recuperado de https://www.boe.es/diario_boe/txt.php?id=BOE-A-2025-5151

OTAN. (2021, 12 de agosto). Countering disinformation: improving the Alliance’s digital resilience. Recuperado de https://www.nato.int/docu/review/articles/2021/08/12/countering-disinformation-improving-the-alliances-digital-resilience/index.html (consultado 14/08/2024).

OTAN, Headquarters. (2024). Hybrid threats and hybrid warfare: Reference curriculum. Recuperado de https://www.nato.int/nato_static_fl2014/assets/pdf/2024/7/pdf/241007-hybrid-threats-and-hybrid-warfare.pdf (consultado 14/08/2024).

PDC-01. Publicación Doctrinal Conjunta PDC-01 (A) Doctrina para el empleo de las FAS. Estado Mayor de la Defensa, 2018. Recuperado de https://publicaciones.defensa.gob.es/pdc-01-a-doctrina-para-el-empleo-de-las-fas-libros-papel.html (consultado 14/08/2024).

Pennycook, G., & Rand, D. G. (2021). The psychology of fake news. Trends in Cognitive Sciences, 25(5), 388-402. Recuperado de https://www.cell.com/trends/cognitive-sciences/fulltext/S1364-6613(21)00051-6 (consultado 06/04/2025).

Pennycook, G., Bear, A., Collins, E. T., & Rand, D. G. (2020). Fighting misinformation on social media using crowdsourced judgments of news source quality. Proceedings of the National Academy of Sciences, 117(7), 2775-2785. https://www.pnas.org/doi/abs/10.1073/pnas.1806781116 (consultado 02/06/2025).

Posetti, J., & Matthews, A. (2018). A short guide to the history of 'fake news' and disinformation. International Center for Journalists. Recuperado de https://www.icfj.org/sites/default/files/2018-07/A%20Short%20Guide%20to%20History%20of%20Fake%20News%20and%20Disinformation_ICFJ%20Final.pdf (consultado 06/04/2025).

Quiñones de la Iglesia, F. J. (2021). Desinformación y subversión (2.0): las técnicas de la Guerra Fría reaparecen en el dominio informativo del siglo XXI. Documento Marco IEEE 12/2021. Recuperado de https://www.ieee.es/Galerias/fichero/docs_marco/2021/DIEEEM12_2021_FRAQUI_Desinformacion.pdf (consultado 06/04/2025).

Reuters Institute for the Study of Journalism. (2024). Digital News Report 2024. Oxford University. Recuperado de https://reutersinstitute.politics.ox.ac.uk/es/digital-news-report/2024 (consultado 06/04/2025).

Rid, T. (2021). Desinformación y guerra política. Barcelona: Crítica.

Rodrigo Alsina, M. (2005). La construcción de la noticia. Recuperado de https://www.um.es/tic/LIBROS%20FCI-I/La%20produccion%20de%20la%20noticia.pdf (consultado 20/08/2024).